人工智能正以前所未有的速度进入"智能体时代"。从LangChain、CrewAI到AutoGen,各种强大的Agent框架如雨后春笋般涌现,每个都承诺能构建出超级智能的数字助手。然而在这片繁荣之下,一个严峻的现实浮出水面:我们正在建造一座新的"巴别塔"。

这些智能体虽然各自能力超群,却说着不同的"语言"。一个用LangChain构建的文档处理助手,无法直接与CrewAI构建的数据分析专家对话;AutoGen的报告生成器也听不懂其他框架智能体的指令。每当我们想要让它们协作时,开发者就必须编写大量定制化的胶水代码,既昂贵又脆弱。

更糟糕的是,这种碎片化正在阻碍整个AI生态的发展。企业投入巨资训练的专业智能体被困在各自的技术孤岛中,无法形成真正的协作网络。我们距离构建复杂的多智能体系统还很遥远,更别说实现AI团队无缝协作的愿景了。

破解"巴别塔"困境

IBM的BeeAI团队(现已交由Linux基金会管理)推出Agent 通信协议:Agent Communication Protocol (ACP)。这个被誉为"AI智能体领域的HTTP协议"的标准,正是为了让所有智能体都能说同一种"世界语"而诞生的。

📖 参考阅读:

ACP到底是什么?

简单来说,ACP就是让不同AI智能体能够互相"对话"的通用语言。就像HTTP协议让全世界的网站都能互相访问一样,ACP让所有智能体都能无障碍沟通。

ACP的设计理念非常务实。它基于成熟的REST架构,任何熟悉Web开发的工程师都能快速上手,甚至可以用cURL命令直接测试。更重要的是,它完全框架无关,不管你用什么技术栈构建智能体,都能通过一个简单的适配层接入ACP网络。而且ACP天然支持多模态数据传输,无论是文字、图片、音频还是自定义格式,都能无缝处理。

最关键的是,ACP现在由Linux基金会管理,这确保了它的开放性和中立性,开发者不用担心被某个大厂"绑架"。

ACP的诞生背景

AI生态碎片化的痛点

当前的AI智能体生态就像是一个"语言巴别塔"。LangChain框架的智能体说"LangChain语",CrewAI框架的智能体说"CrewAI语",AutoGen框架的智能体说"AutoGen语"。每当开发者想要让不同框架的智能体协作时,就必须为每种组合编写昂贵、脆弱、不可复用的定制化集成代码。

这种碎片化问题已经严重阻碍了大规模AI系统的构建。企业想要组建跨团队的AI协作网络变得异常困难,整个AI生态的健康发展也受到了限制。更关键的是,这种技术孤岛状态让AI的真正潜力无法释放出来。

ACP的核心使命很明确:统一AI智能体的通信标准。它要让所有智能体都能无缝对话协作,实现快速集成部署,并支持灵活的组合编排。说白了,就是要打破技术壁垒,让AI智能体之间的合作变得像人类团队协作一样自然。

ACP的三大核心优势

1️⃣ 简单到极致的通信方式

还记得用浏览器访问网站有多简单吗?ACP就是这样设计的。它基于每个开发者都熟悉的REST架构和HTTP协议,任何会写Web应用的程序员都能快速上手。你甚至可以用Postman、cURL甚至浏览器直接测试智能体的接口,就像调试普通的Web API一样简单。

ACP团队选择REST而不是更复杂的JSON-RPC,背后有着深思熟虑的考量。REST的普及性意味着开发者不需要学习新的协议规范,现有的网关、负载均衡器、监控工具都能直接使用。这种务实的设计大大降低了技术门槛和部署成本。

2️⃣ 高度灵活的部署架构

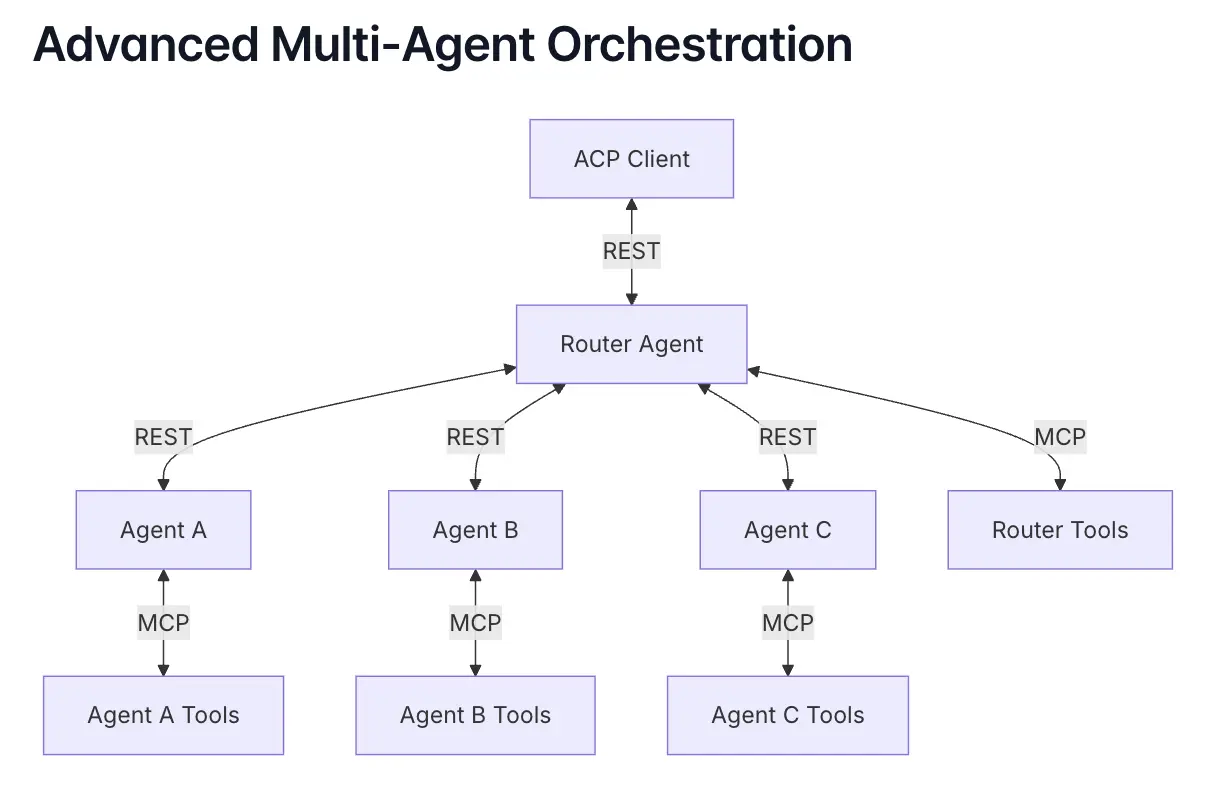

ACP支持三种截然不同的部署模式,可以根据实际需求灵活选择。

最简单的是单智能体模式,一个客户端直接对接一个智能体,特别适合快速原型开发、简单任务处理和调试测试。当你的应用规模扩大时,可以升级到多智能体单服务器模式,让一个服务器同时托管多个相关的智能体,这样既能优化资源利用,又便于集中管理。

如果你要构建大型的企业级AI系统,分布式多服务器架构就派上用场了。每个服务器可以独立部署和扩展,不同类型的智能体可以实现故障隔离,整个系统的可用性和性能都能得到保障。

3️⃣ 独特的离线发现机制

ACP最有趣的特性之一就是"离线发现"功能。传统的服务发现都需要服务在线运行,但ACP可以把智能体的"能力清单"直接嵌入到分发包中。

这意味着即使某个智能体暂时不在线,其他系统也能知道它的存在和具体能力。这种设计对云原生架构特别友好,支持"按需启动"的资源管理模式。更重要的是,它解决了企业内网和边缘计算场景中的服务发现难题,让智能体系统可以在任何环境中灵活部署。

ACP vs MCP vs A2A

| 特性 | Agent Communication Protocol (ACP) | Model Context Protocol (MCP) | Agent-to-Agent (A2A) Protocol |

|---|---|---|---|

| 核心目标 | 智能体之间 | 单个智能体 | 公共发现与交互 |

| 形象比喻 | 智能体网络的 HTTP/TCP/IP。 | LLMs 工具的 USB-C 端口。 | 智能体的数字名片/公共黄页。 |

| 交互范围 | 智能体 ↔ 智能体 | 智能体 ↔ 工具/数据源 | 智能体 ↔ 智能体(侧重公共发现) |

| 开发者 | IBM (BeeAI) | Anthropic | |

| 治理模式 | Linux 基金会(开放治理) | Anthropic(企业主导的开源项目) | Google(企业主导的开放标准) |

| 通信风格 | REST over HTTP | JSON-RPC | JSON-RPC over HTTP/HTTPS |

| 架构焦点 | 本地优先,灵活部署(如一机多体) | 客户端-服务器模式,用于工具访问 | 公共互联网发现,通常一机一体 |

| 关键特性 | 离线发现、REST 简洁性、开放治理 | 专注于丰富单个模型的上下文 | 用于公共、DNS 发现的“Agent Cards” |

| 主要用例 | 构建协作式多智能体团队、企业内部工作流、边缘计算 | 为单个智能体赋予能力(如数据库访问、API 调用) | 使智能体能找到并委托任务给公共的第三方智能体服务 |

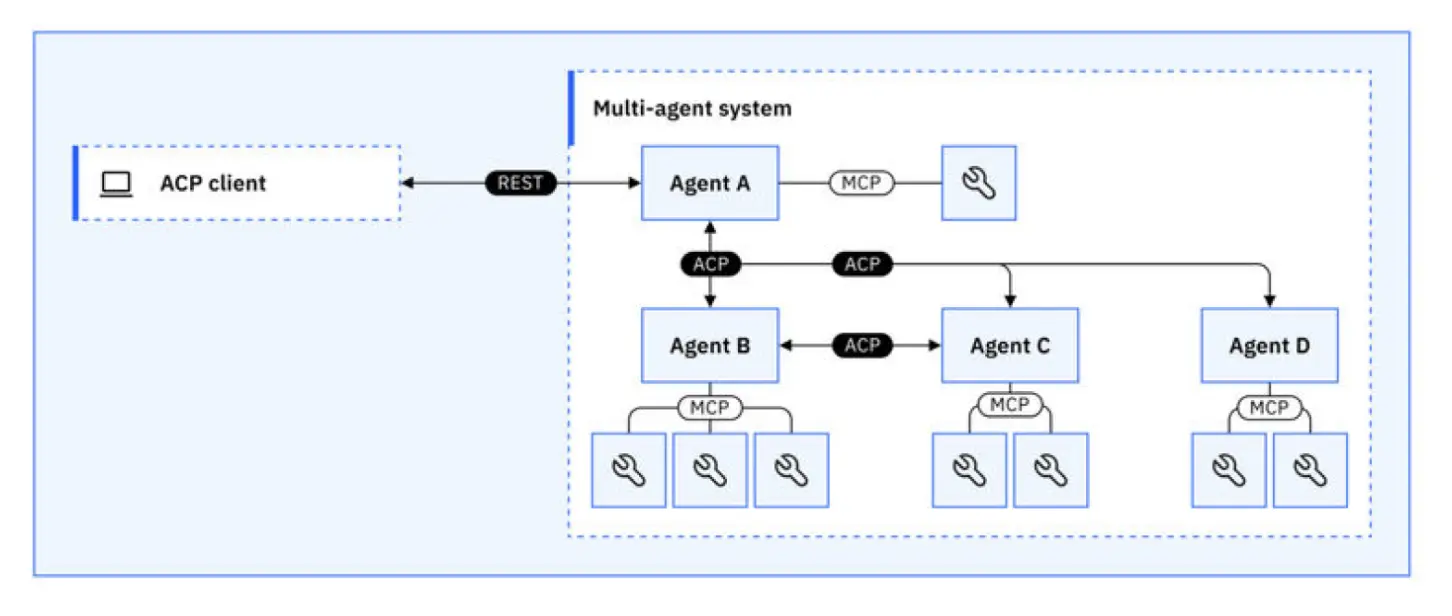

它们如何协同工作

理解这些协议的关键在于认识到它们构成了一个新的“协议栈”,就像网络世界的 TCP/IP 协议栈一样,每一层都解决不同的问题。

MCP更像是"工具驱动层",它专注于解决单个智能体如何连接外部工具的问题。比如让你的AI助手能够访问数据库、调用API、读取文件系统等。

ACP则扮演"协作通信层"的角色,重点解决团队内智能体如何相互协作的问题。比如在企业内部,让财务AI、法务AI和市场AI能够无缝配合完成复杂的业务流程。

A2A主要承担"公共发现层"的功能,它的强项是帮助智能体发现和使用公共互联网上的第三方智能体服务,比如调用专门的翻译服务或内容审核服务。

为什么选择使用ACP?

与其他协议不同,ACP最大的优势在于它由Linux基金会管理。这个看似简单的治理结构调整,实际上解决了企业和开发者最核心的担忧:供应商锁定。

当一个协议被单一公司控制时,无论这家公司多么有名,都存在技术路线突然改变、商业策略调整甚至公司被收购的风险。而Linux基金会的中立地位确保了ACP的发展方向完全由社区需求驱动,而不是某家公司的商业利益。这种开放治理模式为长期技术投资提供了坚实的保障。

ACP的设计目标就是要"将当前碎片化的智能体生态转变为互联互通的协作网络",而开放治理正是实现这一目标的关键基础。

ACP最聪明的地方在于,它的架构设计与现代微服务最佳实践高度一致。这意味着熟悉Kubernetes、Docker、服务网格的团队可以直接应用现有经验,无需重新学习一套全新的范式。ACP天然支持容器化部署、水平扩展、故障隔离等云原生特性,可以无缝融入现有的DevOps工具链。

ACP协议的出现标志着AI智能体生态正在从"各自为政"走向"协同合作"。它不仅仅是一个技术标准,更代表着AI发展思路的根本性转变:从追求单体智能的极致优化,转向构建智能体网络的协作效应。

这种转变的意义是深远的。就像互联网的出现让孤立的计算机变成了全球信息网络一样,ACP正在为AI世界铺设类似的"高速公路"。在这条路上,每个智能体都不再是孤岛,而是一个更大智能网络中的节点。

在下篇文章中,我们将从理论走向实践,教你构建ACP智能体,探索真实世界的应用场景。

敬请关注下篇:《ACP协议让AI团队协作成为现实:从零构建你的AI智能体团队》!

📚 推荐阅读

想要深入了解ACP协议?推荐查看以下资源: