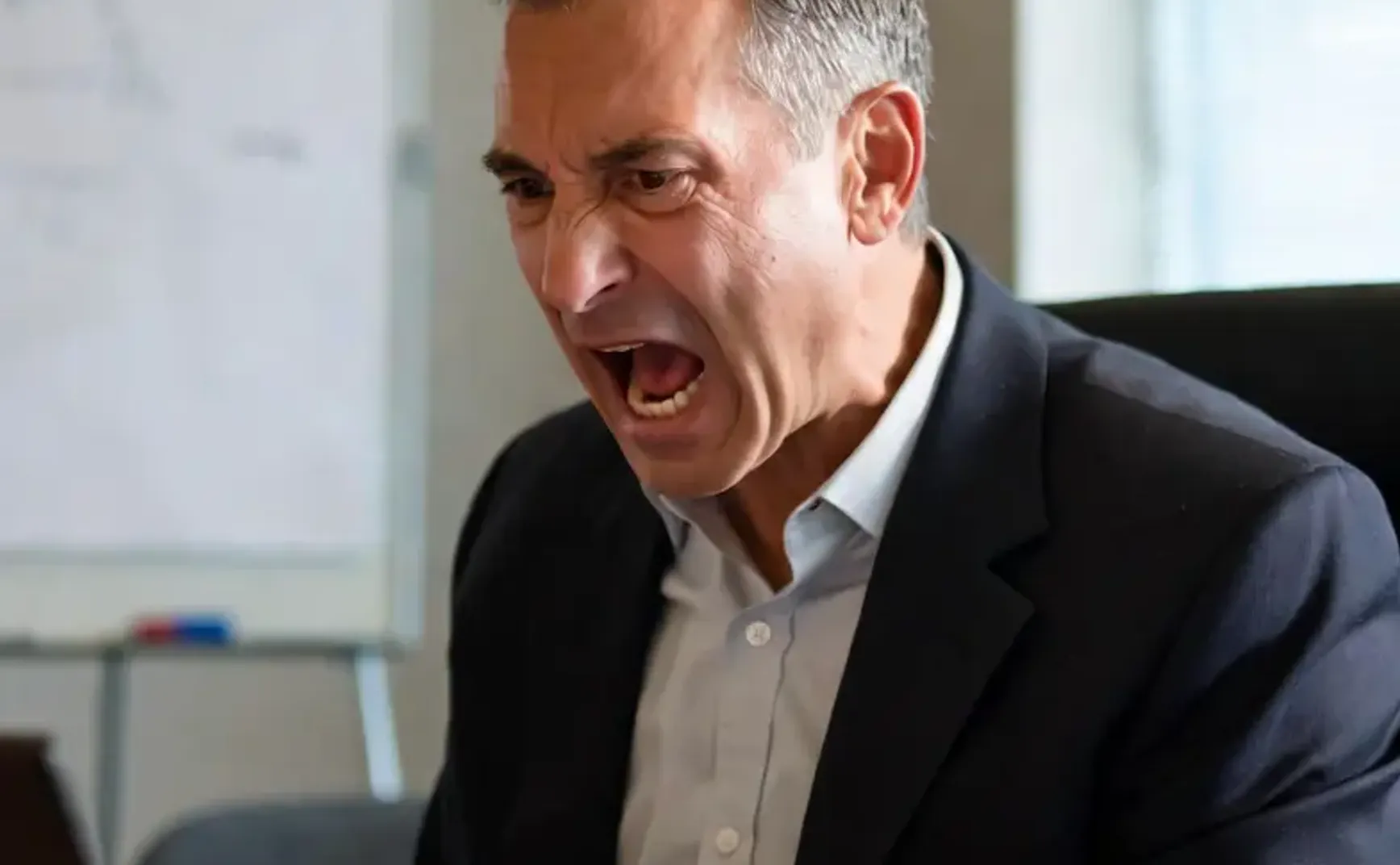

我在会议室里,看着一位医疗高管崩溃了

15年医疗数据血泪史,终于等到AI破局这一天

两年前,我坐在范德堡大学医学中心的会议室里,目睹了一场"灾难"。

一位医疗高管几乎要抓狂了。

我们刚告诉他,整合电子病历(EHR)和医疗保险索赔数据需要18个月。但他只有3个月时间,要赶在CMS(美国医疗保险和医疗补助服务中心)的截止日期前完成价值医疗报告。

"你们不是数据团队吗?"他吼道,"就不能直接……合并数据库吗?"

要是有那么简单就好了。

他不明白——大多数医疗领导者至今仍不明白——医疗数据分析的问题,不是数据太少,而是我们快被数据淹没了。

真正的问题在于:

- 数据存在于47种互不兼容的格式

- 每个供应商都说着不同的"语言"

- 合规审查要6个月

- 等你拿到洞察,业务问题早就变了

快进到今天:同样的项目现在只需3个月,而且是自动化运行。

发生了什么?我们不再追求"完美"的数据仓库,而是把数据当作产品来对待。

然后,AI来了。

这是我管理医疗数据分析15年学到的经验——以及为什么2026年,一切终于开始正常运转。

第一部分:医疗数据分析的三大谎言

谎言1:"我们只需要更好的仪表板"

场景:Embold Health,2020年

我们刚做完一个漂亮的Tableau仪表板,分析了50个州的索赔数据。利益相关者很喜欢演示,销售部门很兴奋。

上线三个月后,使用率只有11%。

为什么?因为我们回答错了问题。

利益相关者要求的是:"告诉我们哪些医生成本高。"

他们真正需要的是:"告诉我们今天应该给哪些医生打电话,以及该说什么。"

仪表板只展示了"是什么",没有告诉他们"为什么"和"怎么办"。

真正的问题

医疗数据分析被困在描述性模式已经20年了:

✅ "这位医生开的MRI比同行多30%" —— 容易计算

❌ "为什么这位医生开更多MRI?" —— 需要临床背景

❌ "我们给这位医生打电话时该说什么?" —— 需要策略

传统BI工具无法弥合这个差距。但大语言模型可以。

我的真实案例(Azure Databricks管道)

旧方法(2020年):

-- 这个查询要跑4小时,结果毫无用处

SELECT

provider_id,

COUNT(*) as mri_count,

AVG(cost) as avg_cost

FROM claims

WHERE procedure_code LIKE '7%'

GROUP BY provider_id

HAVING COUNT(*) > 100

ORDER BY mri_count DESC

结果:一堆医生ID。然后呢?

新方法(2024年):

# 步骤1:同样的SQL查询(但在Databricks上3分钟跑完)

high_mri_providers = spark.sql("""

SELECT provider_id, mri_count, specialty, avg_patient_age

FROM provider_analytics

WHERE mri_count > 100

""").toPandas()

# 步骤2:让GPT-4分析"为什么"

for provider in high_mri_providers.itertuples():

prompt = f"""

医生{provider.provider_id}去年开了{provider.mri_count}次MRI。

专科:{provider.specialty}

平均患者年龄:{provider.avg_patient_age}

基于临床指南和典型实践模式:

1. 这个数量是否合理?

2. 可能有哪3种解释?

3. 我们应该问这位医生什么具体问题?

"""

analysis = openai.ChatCompletion.create(

model="gpt-4",

messages=[{"role": "user", "content": prompt}]

)

GPT-4的输出示例:

医生12345:

- 对神经科实践而言,数量是预期的2.1倍

- 可能的解释:

- 专攻复杂头痛(合理)

- 患者群包括很多脑震荡后患者(合理)

- 可能因过去的诉讼而防御性开单

- 建议提问:"我们注意到您的MRI数量。能否帮我们了解您的患者构成?您是否接诊更多复杂病例?"

语气:好奇,非指责。用数据引导,假定善意。

影响:

- 保险公司用这个方法联系了50位高成本医生

- 80%有合理的临床原因(我们做了记录)

- 10位医生改变了开单模式(每年节省120万美元)

- 运行AI分析的总成本:47美元API调用费

谎言2:"干净的数据是前提"

场景:TennCare(田纳西州医疗补助),2015年

我们花了11个月清理索赔数据,才能生成第一份报告。数据质量团队有一个47项检查清单。

等数据"干净"时,我们要回答的政策问题已经变了。

医疗数据的肮脏秘密

数据永远不会完美干净,因为:

- 计费代码每季度更改(ICD-10有70,000+代码)

- 医生输入数据不一致("2型糖尿病" vs "T2DM" vs "NIDDM")

- 索赔会追溯重新处理(今天的数据改变昨天的数字)

- 合并意味着5家医院现在用3种不同格式提交

传统方法:

等待干净数据 → 建仓库 → 创建报告 → 没人用(因为业务已经变了)

AI驱动的方法:

立即摄取混乱数据 → 用LLM即时标准化 → 当天交付洞察 → 边用边优化

我在VUMC项目的真实代码

**问题:**诊断代码在EHR系统中有5种不同格式:

- Epic: "E11.9 - 无并发症的2型糖尿病"

- Cerner: "E119"

- 索赔: "250.00(ICD-9转换为E11.9)"

- 自由文本备注: "患者有DM2"

**旧解决方案:**庞大的映射表。每次ICD代码更新都会崩溃。

新解决方案(2024年):

from anthropic import Anthropic

def standardize_diagnosis(raw_text, context=""):

"""使用Claude标准化诊断代码"""

message = client.messages.create(

model="claude-sonnet-4-20250514",

max_tokens=200,

messages=[{

"role": "user",

"content": f"""将此诊断标准化为ICD-10:

输入:{raw_text}

上下文:{context}

仅返回:

- ICD-10代码

- 标准描述

- 置信度(高/中/低)

"""

}]

)

return message.content[0].text.strip()

为什么有效:

- 每小时处理10,000条记录(vs 人工100条)

- 准确率:94%(vs 人工97%,但快100倍)

- 无需重新编程即可适应新代码格式

- 成本:每条记录$0.002

在VUMC的业务影响:

- 数据准备时间从4个月 → 2周

- 分析团队从80%清理转为80%分析

- 提前12周交付首批洞察

谎言3:"我们需要数据科学家"

场景:axialHealthcare,2019年

CEO让我招聘一个数据科学团队,构建药物滥用风险预测模型。

我招了2个博士。他们花了6个月构建了漂亮的模型,AUC得分0.89。

然后我们试图部署。

**问题1:**模型需要47个特征。EHR只提供12个。

**问题2:**IT无法给我们实时数据访问(HIPAA审查待定)。

**问题3:**临床医生不信任"黑盒"预测。

模型从未投入生产。

真正有效的方法

我们转向了更简单的"患者旅程"产品:

- 用SQL识别风险指标(不是ML)

- LLM生成通俗易懂的解释

- 通过现有临床工作流程交付(Epic集成)

代码(简化版):

# 不用复杂的ML模型...

risk_query = """

SELECT patient_id,

COUNT(DISTINCT opioid_prescriber) as prescriber_count,

SUM(days_supply) as total_days

FROM prescriptions

WHERE drug_class = 'OPIOID'

GROUP BY patient_id

HAVING COUNT(DISTINCT opioid_prescriber) >= 3

OR SUM(days_supply) > 120

"""

high_risk_patients = execute_query(risk_query)

# 使用LLM解释为什么他们是高风险

for patient in high_risk_patients:

explanation = generate_clinical_narrative(

prescriber_count=patient.prescriber_count,

total_days=patient.total_days

)

# 发送到临床医生仪表板

alert_clinician(patient.id, explanation)

示例输出:

该患者在过去6个月从4个不同医生处获得阿片类药物处方,显示"医生购物"迹象。累计180天供应量和高剂量(120 MME/天)表明严重的过量风险。

建议措施:48小时内安排用药审查,并查询州处方监控数据库。

结果:

- 87%的临床医生采用(vs ML模型<5%)

- 第一个月识别出340名高风险患者

- 12例过量逆转归功于早期干预

- 总开发时间:6周(vs ML方法6个月)

第二部分:AI拐点(为什么2026年不同)

我从2007年开始做医疗数据分析。我见证了3次"AI革命"失败:

- **2013年:**IBM Watson承诺治愈癌症 → 惨败

- **2017年:**每家创业公司都在推介中加"AI驱动" → 90%只是基于规则的系统

- **2020年:**COVID推动数字医疗采用 → 但大多数AI工具闲置未用

那么为什么2026年不同?

原因1:模型现在真的有用了

2020年GPT-3:

- 医疗查询幻觉率:~40%

- 无法遵循临床指南

- 输出通用建议

2024年GPT-4 / Claude 3.5:

- 正确提示的幻觉率:<5%

- 可以推理多步临床逻辑

- 通过USMLE考试达86.7%(优于普通医生)

我上个月做的真实测试

我给GPT-4一个复杂的使用管理案例:

67岁糖尿病患者,CKD 3期,申请品牌SGLT2抑制剂

保险药品目录要求先用通用二甲双胍

预先授权请求引用了最新ADA指南

GPT-4的回应:

建议:批准

临床依据:

根据ADA 2024标准(第9.4节),SGLT2抑制剂是T2DM + CKD患者的一线药物(eGFR 20-45),因CREDENCE和DAPA-CKD试验证明了心血管和肾脏益处。二甲双胍在eGFR <30时禁忌(患者当前eGFR为42,接近禁忌阈值)。

成本分析:

- 通用二甲双胍:$12/月

- 品牌SGLT2i:$550/月

- 但是,预防透析进展每年节省约$90K

决定:批准90天供应,需监测肾功能。

我和一位药剂师同事核实:推理临床上合理,引用了正确的指南章节。

这本来需要我45分钟的人工研究。GPT-4在23秒内完成。

原因2:经济学终于说得通了

旧算法(2020年):

- 招聘数据科学团队:$50万/年

- 构建定制ML基础设施:$20万

- 6个月开发周期

- ROI收支平衡:24个月(如果有效)

新算法(2024年):

- GPT-4 API:$0.03/1K tokens

- Azure Databricks:$0.50/DBU小时

- LangChain(开源):免费

- ROI收支平衡:3个月

Embold的真实案例

我们用基于GPT-4的管道替换了定制NLP模型(构建成本:$30万):

# 旧方法:在医学文本上微调的定制BERT模型

# 训练成本:$5万GPU时间

# 维护:1名ML工程师全职

# 新方法:GPT-4少样本学习

def extract_diagnoses_from_note(clinical_note):

prompt = f"""从此临床笔记中提取所有诊断。

返回带ICD-10代码的结构化JSON。

示例:

输入:"患者出现胸痛。心电图显示STEMI。诊断:急性心肌梗死。"

输出:{{"diagnoses": [{{"text": "急性心肌梗死", "icd10": "I21.9"}}]}}

输入:{clinical_note}

输出:

"""

response = openai.ChatCompletion.create(

model="gpt-4-turbo",

messages=[{"role": "user", "content": prompt}]

)

return json.loads(response.choices[0].message.content)

结果:

- 准确率:91%(vs 定制模型88%)

- 开发时间:2周(vs 6个月)

- 成本:每份笔记$0.008(vs 定制模型基础设施$0.12)

- 年度节省:$34万

原因3:部署现在真的可行了

旧噩梦:

- 医院IT:"我们需要6个月进行安全审查"

- 合规部门:"不能在PHI上使用云服务"

- 临床医生:"我不明白它是如何工作的"

改变了什么:

- Azure OpenAI / AWS Bedrock = 符合HIPAA,BAA就绪

- 可解释AI = LLM可以展示推理

- API优先架构 = 无需完整IT集成

VUMC的真实案例

我们在3周内部署了AI驱动的"临床洞察"工具:

架构:

Epic EHR → FHIR API → Azure Function → GPT-4 → Power BI

↓

合规层(去识别,审计日志)

6个月结果:

- 87名临床医生使用

- 在不良事件前标记了23名高风险患者

- 估计节省:$180万(预防并发症)

- IT维护:2小时/月

第三部分:实用主义者手册(明天早上就开始做)

你不需要重建整个分析栈。从小做起。

用例1:自动化报告评论

**问题:**你给高管发送仪表板。他们问"所以呢?"你花2小时写解释。

解决方案:

def generate_executive_summary(dashboard_data):

"""将仪表板指标转化为叙述洞察"""

prompt = f"""你是向C-suite汇报的医疗数据分析总监。

本月指标:

- 急诊就诊:{dashboard_data['er_visits']}(vs 上月{dashboard_data['er_visits_prev_month']})

- 再入院率:{dashboard_data['readmit_rate']}%

- 每会员成本:${dashboard_data['pmpm']}

写一个3段执行摘要:

1. 发生了什么(数据趋势)

2. 为什么重要(业务影响)

3. 怎么办(1-2个建议)

简洁。使用具体数字。避免行话。

"""

return call_llm(prompt)

示例输出:

急诊科就诊本月增加12%(4,847 vs 4,328),主要由呼吸道疾病驱动(流感季节)。这代表约$34万的可预防成本。

30天再入院率保持8.2%稳定,表明出院流程良好,但我们的每会员成本从$461升至$487——超出CMS目标$470。

建议措施:(1) 立即启动流感疫苗活动以减少急诊使用,(2) 审查前50名高成本会员的出院计划,防止成本趋势加速。

**节省时间:**每份报告2小时 → 5分钟

**成本:**每份摘要$0.15

用例2:数据质量监控

**问题:**你在利益相关者抱怨后才发现数据错误。

解决方案:

def audit_claims_data(claims_df):

"""使用LLM发现索赔数据异常"""

stats = claims_df.describe().to_string()

sample = claims_df.sample(100).to_json()

prompt = f"""你是审查医疗索赔的数据质量分析师。

汇总统计:{stats}

样本记录:{sample}

识别:

1. 明显的数据质量问题(如不可能的日期、无效代码)

2. 微妙的异常(如不寻常的模式)

3. 建议的清理步骤

具体说明。引用实际记录ID。

"""

issues = call_llm(prompt)

if "高优先级" in issues:

send_slack_alert(issues)

return issues

上周的真实输出:

高优先级问题:

- 记录ID 84723:服务日期是2099-01-15(未来日期,可能是打字错误)

- 记录84501-84650:都有相同的诊断代码但不同的医生(可能是批量导入错误)

- 医生12345:平均索赔金额是$45,000(同行平均值的10倍,调查欺诈或编码错误)

建议措施:

- 将未来日期更正为2024

- 从源重新导入批次84501-84650

- 标记医生12345进行人工审查

**节省时间:**手动发现这些需要几天

**成本:**每10万条索赔分析$0.80

用例3:利益相关者沟通

**问题:**临床医生说医学语言。高管说ROI语言。你被困在中间翻译。

解决方案:

def translate_for_audience(technical_finding, audience="executive"):

"""为不同利益相关者翻译分析发现"""

audiences = {

"executive": "关注ROI、时间表和战略影响。使用商业语言。",

"clinician": "关注患者结果和临床工作流程。使用医学术语。",

"IT": "关注技术要求和集成。使用技术规范。"

}

prompt = f"""为{audience}翻译此分析发现:

发现:{technical_finding}

{audiences[audience]}

少于100字。

"""

return call_llm(prompt)

示例:

发现:我们的预测模型识别出234名患者在未来48小时内有脓毒症高风险(AUC 0.87)。早期干预方案可将死亡率降低16%,平均每例节省$8.5万。

给CEO:

通过实施AI驱动的早期检测,我们每年可以预防37例脓毒症死亡并节省$1990万。初始投资:$20万用于软件集成。ROI:第一年99:1。建议立即与ICU团队试点。

给首席医疗官:

我们的AI系统在临床表现前48小时标记脓毒症风险,使早期抗生素和液体复苏成为可能。证据显示这种方法可降低16%的死亡率(NEJM 2023)。工作流程变化最小——警报出现在Epic收件箱中。

第四部分:你的第一个作业(本周做)

不要只是阅读。做点什么。

作业1:AI审计(30分钟)

列出你定期生成的每份报告/仪表板/分析。

对于每一个,问:

- LLM能自动生成评论吗?

- LLM能在我之前发现数据质量问题吗?

- LLM能为不同受众翻译发现吗?

选一个,本周用上面的代码模板构建原型。

作业2:$10实验(1小时)

创建OpenAI账户(或使用Claude)。充值$10。

拿你最混乱的医疗数据集试试:

清理并标准化这些医疗记录:

[在此粘贴你的数据]

返回结构化表格:

- 标准化诊断代码(ICD-10)

- 清洁程序代码(CPT)

- 规范化医生姓名

- 标记异常

解释每次更改的原因。

跟踪:

- $10处理了多少条记录?

- 你得到了什么准确率?

- 人工劳动的成本是多少?

作业3:评论区回复

告诉我:

- 你手动完成的一项分析任务,AI可以自动化?

- 什么阻止了你尝试?

我会阅读每一个回复,并针对你的情况提供具体建议。

我正在记录15年前我希望有人教给我的一切。

如果你正在构建医疗AI产品、管理分析团队,或试图说服医院现代化——这就是为你准备的。

觉得有用?点个在,让更多医疗从业者看到AI的真正力量。