你好!

细心的话,你可能已经发现最近的配图,更换了使用的算法,由 Disco Diffusion 变成 Stable Diffusion,看似换了一个单词,其实背后的差异是巨大的。

就自己使用体验来说,短短几个月,能感受到AI绘画正在突飞猛进地进化。结合最近阅读的技术发展相关文章后,觉得更有意思,可以跟你分享一下。

AI生成,会在接下来成为一个新趋势。

Any sufficiently advanced technology is indistinguishable from magic.——Arthur C. Clarke

任何足够先进的技术,与魔法无异。——阿瑟∙克拉克

题图:上海的甘道夫厌倦了快餐

AI设计师:Stable Diffusion

参考艺术家:Jeremy Mann & Alphonse Mucha

人类小助理:阿颖

亲测AI绘画:DD & SD

早在AI打败围棋高手时,我们还觉得它只能做一些数学运算工作。艺术里的「创造」「灵感」「灵魂」是属于人类不可取代的一部分,但怎么也没预料到,「AI绘画」直接杀进艺术领域,一时让人类有点措手不及。

蛮有意思的,说不定,下个阶段就是AI写代码,哈哈哈。

回到一开始说的AI绘画,它本质上是根据文字生成图像。技术实现,就是识别你描述的文字内容,理解它的意思,再将意思呈现为画面。

在 第33期 介绍,第一次在使用 Disco Diffusion 时,感觉很惊艳,这项技术绝对称得上是「造梦工具」,很适合描绘想象和梦境。

于是,每期 newsletter 开始用它来绘制插图,除了开心之外,更多是希望将更好的生产力技术,推广给更多人。

可能你会误以为AI绘画很简单,不就是让机器生成就行嘛。实际上不是,为了得到一张好看的图,一般要测试prompt,生成10张左右,才能选到1张风格和画面效果合适的,这过程长的话需要3个小时左右(无论如何,还是比人工绘制要快)。

Disco Diffusion 的随机性,时常带来惊喜,但更多的是「抓狂」,不可控,过于随机,不利于画面的快速迭代,还会浪费很多时间(DD的速度不快,一张大概15分钟)。每次都像是在开盲盒。比如它就没有好好画过一个圆形,在它的世界里,只有椭圆。虽然提供了参考的艺术家,但每次也总是自己超常发挥,时好时坏。

Disco Diffusion 还有一个毛病,就是细节太差,无法绘制生物不说,其它细节也时常扭曲变形。它虽然惊艳,但很难用于商业化使用,更合适是作为「创作灵感参考」。比如:艺术家在DD作品的基础上做二次创作。

本以为这样就已经很不错了,谁能想到,不到2个月,Stable Diffusion 横空出世了,史上最强的AI绘图来了。

当看到 Stable Diffusion 出来的第一张图时,终于明白了为什么它被称为史上最强的AI绘图(现阶段)。

针对 DD 的问题:过于随机,细节不可控,速度过慢,Stable Diffusion 几乎都解决了,不只是速度大幅提升(一张图大概1分钟),尤其对生物、对细节的支持,变得非常好,画什么就能看出是什么。

另外,Stable Diffusion 对画家艺术风格的保留程度更高,出品的艺术效果很好。在生成相似效果的同时,又能略有创新。「喜欢 = 熟悉 + 意外」,这样的出品更能被普遍大众接受。

这几点改善,让AI绘画从原来只是作为参考,直接变成可商用的生产力。

如果不能找到应用场景,AI绘画很容易停留在「玩」的层面,比如:用来生成每期推送的配图。如果只是「玩」就太浪费AI的才能。

这段时间,我也在尝试让不同人付费来购买AI绘画的作品,算是一种市场调研,发现付费者愿意尝试这种新事物,他们的应用场景非常具体,比如:封面设计、室内设计、背景板设计、灵感参考等。有些人还有更加严格的要求,虽然AI绘画有随机性,但付费者仍要求要达到他们理想的设计要求,看来甲方才不管干活的是不是AI,他们只关注实际效果。

看来,资本的压迫,从来就不在乎你是不是人,哈哈哈哈哈。

AI绘画是一种「搜索引擎」

很欣赏 Stable Diffusion,不单单是技术本身,还有它的研发团队 Stability AI,他们的口号是「AI by the people, for the people」,大致意思是「AI从群众中来,到群众中去」。

当初在互联网上训练AI模型,受之于大众,如今,将这么优秀的技术,开源免费给到大众,让我们拥有了模仿画家风格的创作能力。一个毫无绘画基础的人,也能用优秀的画作来表达自己的思想。

2022年 AI 绘画发生的革命性变化,在历史上也是突破性的进展,是AI领域的一个高光时刻。

我们很容易误以为AI绘画,是一种创造技术,因为它总带给我们天马行空的想象,以及花样百出的效果,很难说它不是创造。

但更有意思的视角是认为:AI绘画是一种搜索引擎。

Patrick O’Shaughessy 在推特上 发表了:「AI生成,不是创造性的工具,而是一种新的搜索引擎」,因为以前我们要用搜索引擎去查找想要的东西,但现在 Stable Diffusion 直接给到你想要的结果。你对图像的获取方式改变了。

在阅读相关文章时,了解到AI绘画,或者广义的AI生成, 它们是从数学意义上人类可能创作的作品中,把这些作品挖掘出来。目前这些作品还没有被创作出来,所以这项技术相当于把它们搜索出来。

因为很多深度 AI 模型的核心思路,就是把人类创作的内容,表示为某个高维或者低维数学空间里的一个向量,理解为一个创作要素方向。

当我们把创作要素都转化为数学空间里的向量,那人类所有创作的内容,将会存在于这个空间内,理论上人类是可能把它们创造出来的,但限于人类尝试的次数以及认知的局限,目前尚未创造出它们。

于是,AI的能力,帮我们从这个空间把这些可能性给还原出来。这正是一种新的搜索引擎。

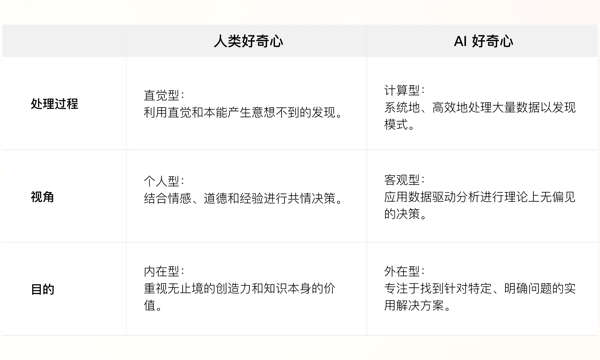

当AI靠着「超级算力+大数据+数学模型」进入创作领域时,我们原本信仰的「灵感」「创造力」「想象力」,正在被技术解构。

AI生成如何影响思想传播

AI能绘画、作曲、写作了,就差AI生成视频,甚至上手写代码,你可能担心AI已经这么厉害了,是不是要抢走你的饭碗了。先不着急,我们可以看看,以AI绘画为代表的AI生成,究竟在参与什么环节,以及带来什么突破。

Ben Thompson 在《 The AI Unbundling》一文中,讲解人类的思想传播链条,是如何一步步被技术所改变的,这里面就能看到AI生成的意义:辅助人类把想法变成现实。这么理解的话,AI生成不但不是坏事,还是人类强有力的助手。

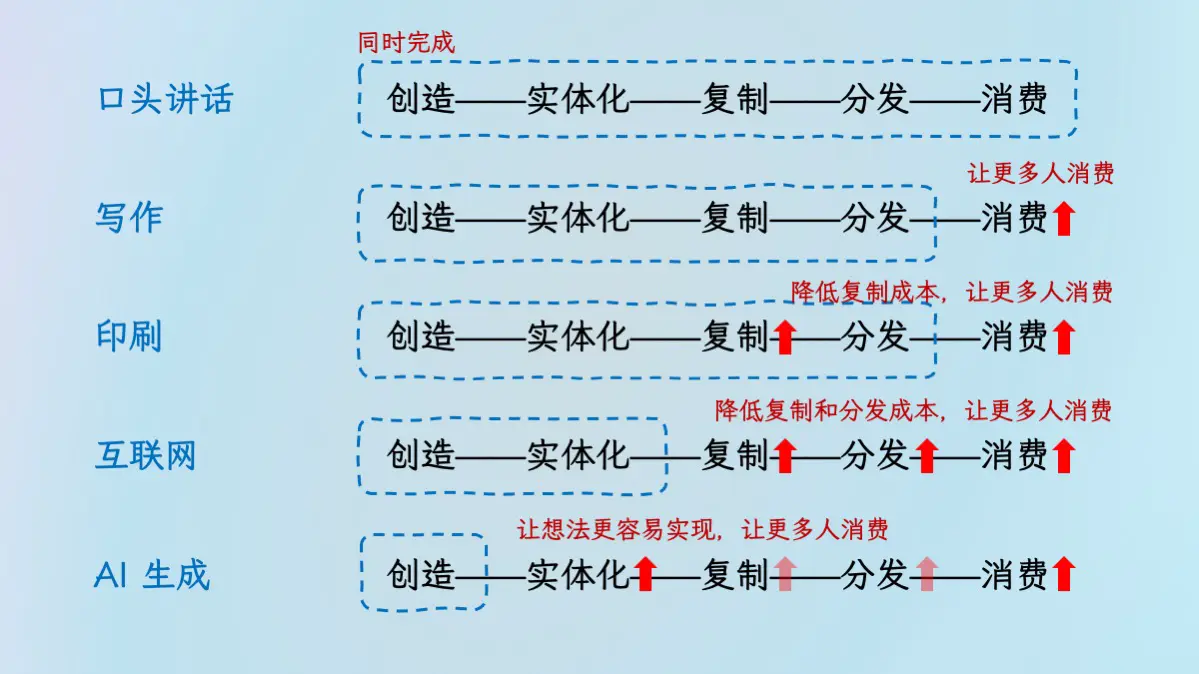

人类在传播思想时,会有5个重要环节:creation——substantiation——duplication——distribution——consumption,分别是:创造——实体化——复制——分发——消费。

从口头到写作,再到印刷,再到互联网传播,逐渐打破思想传播的瓶颈,让更多思想更方便传播给更多的人。

到当前,人类引以为豪的是「创造—实体化」,但对大多数人仍然是创作瓶颈。想想你是不是有很多新奇的想法,奈何自己能力不够,无法将它们变成文字、图片、视频、实体物品。

AI生成的到来,直接杀进这个领域,它们仍然还无法取代人去创造自己的想法,但它们已经能帮助你去将想法实现出来。将原本不可能的能力,普及给更多人,让人能产出更好更多的内容,而这些产出反过来又能加速技术、内容的迭代。

不单单是AI生成,现在也越来越多AI工具出现,它们很多也是辅助「创造——实体化」的过程,比如现在写的newsletter,在完成后,我也是放进AI工具里,去完成错别字和病句检查,大大提高编辑的效率,给你保证一个较好的阅读体验。

张宁老师 在「Platform Thinking +」中 介绍道:

Creation 是创意的本原,我更愿意把它称之为 Ideation,就是产生主意和想法的阶段。这个部分其实是整个内容产生的开端,或许是算法永远都无法替代人类的部分——因为它具有很强的主观性,也是创作者从自身出发,为内容创作赋予意义的过程。

Substantiation 是创意的实现过程,也即是把想法变为内容本体的阶段。比如我现在码字,就是把头脑中的想法变成可以被其他人阅读的文本。这个部分实际上占据了每一次创作的大部分时间,但这个过程早晚会被算法生成所替代——实际上这个 newsletter 中大量的英文翻译工作已经被算法替代掉了。 如果想法创造和实现之间的联系被切断,似乎有理由认为所有相关的商业模式都可能遭受同样的命运。

AI绘画的发展史

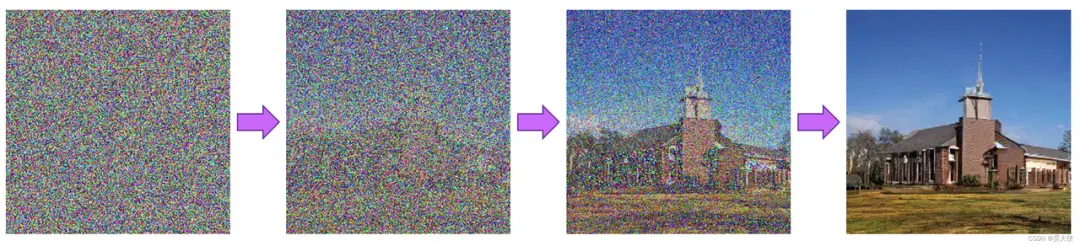

一开始也会好奇为什么两款AI绘画,都要叫「Diffusion」,还以为他们杠上了,最后读了 极客公园整理的AI绘画发展史,才理解到:他们都用了「Diffusion模型」。(感兴趣的朋友,推荐阅读极客公园原文哦)

只是在今年,AI绘画实现了1月一变的进化速度,很难想象再过一年后,它能达到什么高度,但自己很兴奋能看到AI绘画未来的巨大想象空间。

这里简要帮你叙述一下这个发展史:

在上个世纪70年代,艺术家哈罗德·科恩打造了物理意义的AI绘画,实现了电脑程序「AARON」控制机械臂拿笔来作画,有了这个想法。

真正具有突破意义的尝试,是2012年吴恩达和 Jeff Dean训练深度学习网络,生成了一张模糊的猫脸,于是AI绘画有了一个简单的目标:得到一个输出有规律像素组合的AI模型。

后续几个重大的深度学习领域的进步,大大推进了这项技术的进步。2014年,AI有了对抗生成网络 GAN,开始模仿作品,但效果太随机,分辨率低。到了2017年,Google实现了生成简笔画,开始真正独一无二的创作,而不是简单模仿。当然画风还是比较抽象。

2021 年初,OpenAI 发布 DALL-E 系统,实现了用文字来生成图像。他们开源了新的深度学习模型 CLIP,利用互联网海量的图像数据训练,实现了自然语言理解和视觉分析。于是大量机器学习工程师,利用CLIP结合GAN开始生成图像,有了CLIP+VQGAN的交流社区,代码开源,让技术在不断优化改进。

但GAN生成的图像效果始终不佳,于是开发者尝试了另外的思路——Diffusion 模型,利用AI在不断猜测图像的同时,不断去除画面噪点,来得到一张清晰的图片。没想到效果出奇地好,Diffusion 也正在用于视频生成和音频合成。

于是到今年初,Disco Diffusion 诞生,它是第一个基于 CLIP + Diffusion 打造的实用产品,开始生成不俗的绘画作品,逐渐让技术破圈,让更多人知道AI绘画这件事。虽然 DD 并不完美,无法刻画细节,速度还慢,但用 DD 来提供创作的灵感参考已经是相当不错了。

没想到7月,Stable Diffusion登场,直接解决了DD的两个问题,它对模型的计算空间,进行数学变换,大大降低了对内存和计算的要求,提高了运行速度。到目前为止,Stable Diffusion实现了稳定快速的生成效果,基本能满足商业化使用,把一个原本我们想象中的魔法,用技术实现了出来。

AI发展如此之快,过程也很有意思,其中诞生的不只是 Disco Diffusion、Stable Diffusion,还有Midjourney、DALL∙E 2等产品。感兴趣可以试试。

Midjourney 创始人 David Holz 接受采访 时,讲到他对AI 的理解:人工智能是水,而不是老虎。

现在,人们完全误解了AI是什么。他们将AI视为猛虎,是危险的,可能会吃掉我,它是一个对手。水里也有危险,你可能会溺水,但湍急的河水与老虎的危险是截然不同的,水有危险,没错,但你可以在里面游泳、可以坐船,可以用水坝拦住发电。

水是危险的,但它也是文明的驱动力,我们作为指导如何与水一起生活和工作的人类,会活的更好,这是一个机会。水没有意志、没有怨恨,是的,你可能溺水,但这并不意味着我们应该禁止水的存在,当你发现一个新的水源,这真是一件好事。

——💌 感谢你的阅读——

如果给你带来帮助,不妨分享给你的朋友。这是对我最好的支持。 订阅和阅读往期内容。

期待你的回信。每一封回信都会认真回复哦。📮[email protected]

你如果是新朋友,这里准备了 「试行错误」使用手册。

尝试用AI画出你的想法吧!

阿颖

2022-09-27